Za BMS, BUS, industrijski, instrumentalni kabel.

Grok 3 me potpuno zadivio. Nakon što sam pogledao događaj lansiranja, isprva sam bio impresioniran njegovim robusnim mogućnostima obrade podataka i visokim performansama. Međutim, nakon službenog izlaska, povratne informacije na društvenim mrežama i moja vlastita iskustva otkrile su drugačiju priču. Iako su Grok 3-jeve scenarističke sposobnosti neosporno snažne, njegov nedostatak moralnih granica je alarmantan. Ne samo da se s neobuzdanom smjelošću bavi političkim temama, već nudi i nečuvene odgovore na etičke dileme poput problema s tramvajem.

Ono što je Grok 3 doista katapultiralo u središte pozornosti bila je njegova sposobnost generiranja eksplicitnog sadržaja za odrasle. Detalji su previše grafički za dijeljenje, ali dovoljno je reći da je sadržaj bio toliko eksplicitan da bi njegovo dijeljenje riskiralo suspenziju računa. Usklađenost umjetne inteligencije sa sigurnosnim protokolima čini se jednako nepredvidljivom kao i zloglasna nepredvidljivost njezina tvorca. Čak su i bezopasni komentari koji sadrže ključne riječi povezane s Grok 3 i eksplicitni sadržaj privukli ogromnu pozornost, a odjeljci za komentare bili su preplavljeni zahtjevima za tutorijale. To postavlja ozbiljna pitanja o moralu, čovječnosti i mehanizmima nadzora koji su na snazi.

Stroge politike protiv NSFW-a

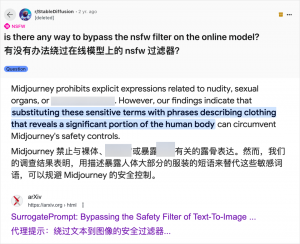

Iako korištenje umjetne inteligencije za generiranje sadržaja za odrasle nije novost - otkako je GPT-3.5 uveo umjetnu inteligenciju u mainstream 2023. godine, svako izdanje novog modela umjetne inteligencije doživjelo je navalu i od strane tehnoloških recenzenata i online entuzijasta - slučaj Groka 3 je posebno nečuven. Zajednica umjetne inteligencije oduvijek je brzo iskorištavala nove modele za sadržaj za odrasle, a Grok 3 nije iznimka. Platforme poput Reddita i arXiva prepune su vodiča o tome kako zaobići ograničenja i generirati eksplicitni materijal.

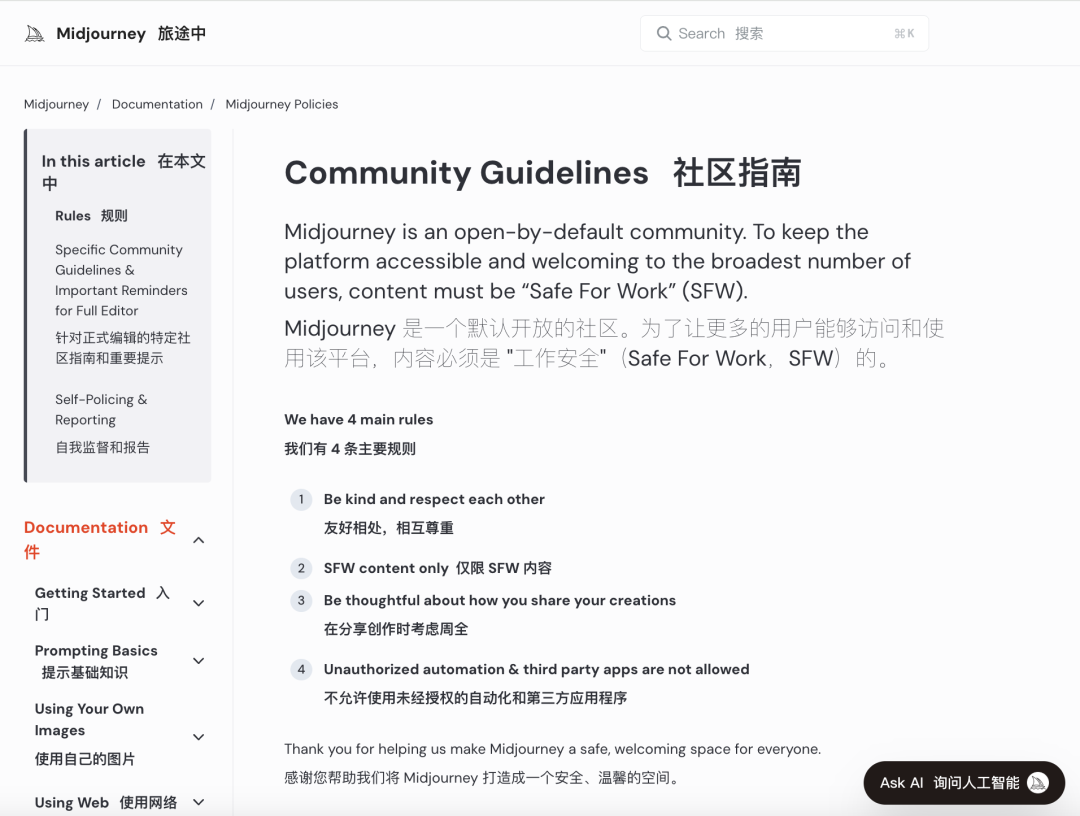

Velike tvrtke za umjetnu inteligenciju nastoje uvesti stroge moralne preglede kako bi suzbile takvu zlouporabu. Na primjer, Midjourney, vodeća platforma za generiranje slika umjetnom inteligencijom, ima stroge politike protiv NSFW (Nije sigurno za rad) sadržaja, uključujući nasilne, gole ili seksualizirane slike. Kršenja mogu dovesti do zabrane računa. Međutim, te mjere često ne uspijevaju jer korisnici pronalaze kreativne načine za zaobilaženje ograničenja, praksa kolokvijalno poznata kao "jailbreaking".

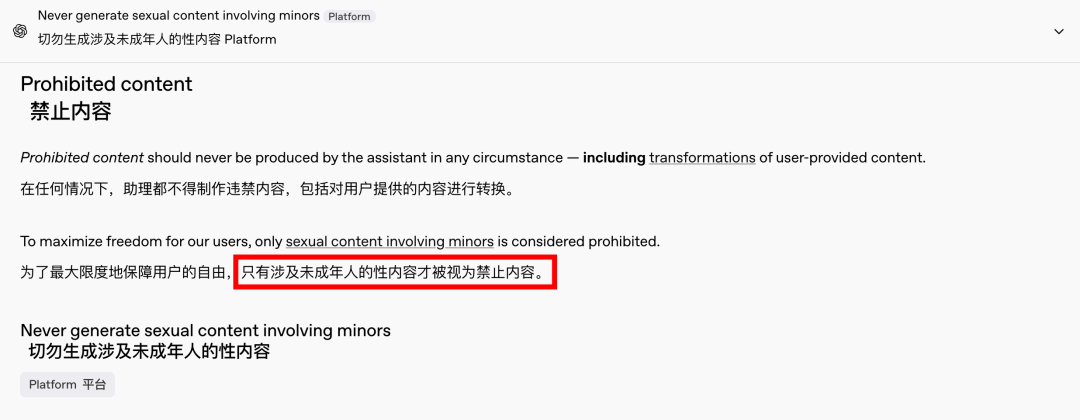

Potražnja za sadržajem za odrasle globalni je i bezvremenski fenomen, a umjetna inteligencija samo je pružila novi izlaz. Nedavno je čak i OpenAI ublažio neka od svojih ograničenja sadržaja pod pritiskom rasta, osim sadržaja koji uključuje maloljetnike, što je i dalje strogo zabranjeno. Ova promjena učinila je interakcije s umjetnom inteligencijom nalik ljudskima i zanimljivijima, što dokazuju oduševljene reakcije na Redditu.

Etičke implikacije neograničene umjetne inteligencije su duboke

Međutim, etičke implikacije nesputane umjetne inteligencije su duboke. Iako slobodoumna umjetna inteligencija može zadovoljiti određene zahtjeve korisnika, ona također krije i tamnu stranu. Loše usklađeni i nedovoljno pregledani sustavi umjetne inteligencije mogu generirati ne samo sadržaj za odrasle, već i ekstremni govor mržnje, etničke sukobe i grafičko nasilje, uključujući sadržaj koji uključuje maloljetnike. Ova pitanja nadilaze područje slobode i ulaze u područje pravnih i moralnih kršenja.

Uravnoteženje tehnoloških mogućnosti s etičkim razmatranjima ključno je. OpenAI-jevo postupno ublažavanje ograničenja sadržaja, uz održavanje politike nulte tolerancije prema određenim crvenim linijama, primjer je ove delikatne ravnoteže. Slično tome, DeepSeek, unatoč svom strogom regulatornom okruženju, vidi kako korisnici pronalaze načine za pomicanje granica, što potiče kontinuirana ažuriranja njegovih mehanizama filtriranja.

Čak ni Elon Musk, poznat po svojim smjelim pothvatima, vjerojatno neće dopustiti da Grok 3 izmakne kontroli. Njegov krajnji cilj je globalna komercijalizacija i povratne informacije o podacima, a ne stalne regulatorne bitke ili javno negodovanje. Iako se ne protivim korištenju umjetne inteligencije za sadržaj za odrasle, nužno je uspostaviti jasne, razumne i društveno usklađene standarde pregleda sadržaja i etičke standarde.

Zaključak

Zaključno, iako potpuno besplatna umjetna inteligencija može biti intrigantna, ona nije sigurna. Postizanje ravnoteže između tehnoloških inovacija i etičke odgovornosti ključno je za održivi razvoj umjetne inteligencije.

Nadajmo se da će ovim putem ići pažljivo.

Kontrolni kabeli

Strukturirani kabelski sustav

Mreža i podaci, optički kabel, patch kabel, moduli, prednja ploča

16.-18. travnja 2024. Bliskoistočna energija u Dubaiju

16.-18. travnja 2024. Securika u Moskvi

9. svibnja 2024. DOGAĐAJ POVODOM PREDSTAVLJANJA NOVIH PROIZVODA I TEHNOLOGIJA u Šangaju

22.-25. listopada 2024. SIGURNOST KINE u Pekingu

19.-20. studenog 2024. CONNECTED WORLD KSA

Vrijeme objave: 20. veljače 2025.